अमेरिका में आर्टिफिशियल इंटेलिजेंस (AI) के सैन्य उपयोग को लेकर बड़ा विवाद खड़ा हो गया है। अमेरिकी राष्ट्रपति डोनाल्ड ट्रंप ने शुक्रवार (27 फरवरी 2026) को सभी संघीय एजेंसियों को निर्देश दिया कि वे Anthropic की AI तकनीक का इस्तेमाल तुरंत बंद करें।

यह फैसला तब सामने आया जब एंथ्रोपिक ने Pentagon की उस मांग को ठुकरा दिया, जिसमें उसकी ‘Claude’ AI मॉडल के बिना शर्त सैन्य उपयोग की अनुमति मांगी गई थी। कंपनी का कहना है कि उसकी तकनीक का इस्तेमाल अमेरिकी नागरिकों की सामूहिक निगरानी या पूरी तरह स्वायत्त हथियार प्रणालियों में नहीं किया जाना चाहिए।

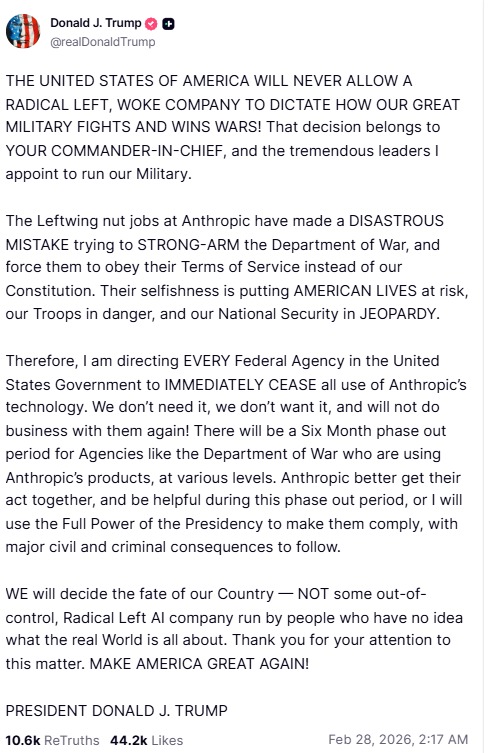

ट्रंप का सख्त आदेश और चेतावनी

राष्ट्रपति ट्रंप ने अपने सोशल मीडिया प्लेटफॉर्म Truth Social पर कड़े शब्दों में कहा कि अमेरिकी सरकार की सभी एजेंसियां एंथ्रोपिक की तकनीक का इस्तेमाल तुरंत बंद करें।

उन्होंने कहा कि रक्षा विभाग समेत जिन एजेंसियों में अभी एंथ्रोपिक की तकनीक इस्तेमाल हो रही है, उनके लिए छह महीने की चरणबद्ध समाप्ति अवधि तय की गई है। ट्रंप ने चेतावनी दी कि अगर कंपनी सहयोग नहीं करती है तो सरकार राष्ट्रपति की शक्तियों का इस्तेमाल कर सकती है, जिसके गंभीर नागरिक और आपराधिक परिणाम हो सकते हैं।

पेंटागन ने पहले ही संकेत दिया था कि अगर कंपनी उनकी मांगों को नहीं मानती है तो उसके खिलाफ Defense Production Act के तहत कार्रवाई की जा सकती है, जो राष्ट्रीय सुरक्षा के मामलों में निजी कंपनियों को निर्देश देने की व्यापक शक्तियां देता है।

एंथ्रोपिक का अडिग रुख

एंथ्रोपिक के CEO डारियो अमोदेई ने स्पष्ट कहा कि सरकार की धमकियों के बावजूद कंपनी अपने रुख से पीछे नहीं हटेगी।

उन्होंने कहा कि कंपनी ऐसी मांग स्वीकार नहीं कर सकती जो उसकी नैतिक सीमाओं और जिम्मेदार AI सिद्धांतों के खिलाफ हो।

AI उद्योग का समर्थन

इस विवाद में पूरे AI उद्योग के कई विशेषज्ञों और कर्मचारियों ने एंथ्रोपिक का समर्थन किया है। Google DeepMind और OpenAI के सैकड़ों कर्मचारियों ने “We Will Not Be Divided” शीर्षक से एक खुले पत्र में सरकार की मांगों का विरोध किया।

पत्र में कहा गया कि AI का इस्तेमाल घरेलू निगरानी या बिना मानवीय नियंत्रण वाले घातक हथियारों के संचालन में नहीं होना चाहिए।

वॉशिंगटन में बढ़ती चिंता

इस बीच OpenAI के CEO सैम ऑल्टमैन ने कर्मचारियों को भेजे संदेश में कहा कि कंपनी पेंटागन के साथ ऐसे समझौते की कोशिश कर रही है, जिसमें AI उपयोग के लिए स्पष्ट ‘रेड लाइन्स’ तय हों।

उन्होंने कहा कि उच्च जोखिम वाले फैसलों में मानवीय निगरानी जरूरी होनी चाहिए।

विशेषज्ञों का मानना है कि सरकार और टेक कंपनियों के बीच बढ़ता यह टकराव पूरे AI सेक्टर और रक्षा तकनीक उद्योग को प्रभावित कर सकता है। उनका कहना है कि सैन्य AI से जुड़े फैसले खुले विमर्श और स्पष्ट कानूनों के तहत होने चाहिए, न कि टकराव के जरिए।

हमारी यूट्यूब चैनल को लाइक, शेयर और सब्सक्राइब करे

Like, Share and Subscribe our YouTube channel